LLMをはじめてみよう — 初心者向けガイドとおすすめマシン紹介

近年、「ChatGPT」や「Gemini」「Claude」に代表される LLM(大規模言語モデル) が一般にも普及し、企業でも導入が急速に進んでいます。しかし、いざ触ってみようと思うと、

- 何から始めればいい?

- どんな機材が必要?

- ローカルでも動くの?

- GPUって何を選べばいい?

といった疑問を持つ方が非常に多いです。

本記事では LLM入門者向けに、「まず何をすればよいか」から「おすすめのサーバ・GPU」までをまるっと解説 します。

初めてLLMを触る方はもちろん、社内PoCや小規模なチャットBOTの検証をしたい方にも役立つ内容です。

1. まずはクラウドのLLMを触ってみよう

LLMに触れる最も簡単な方法は、クラウドのAIサービスを使うことです。

とは言っても、ほとんどの方はどれかしら利用されたことがあるかと思います。

- ChatGPT(OpenAI)

- Gemini(Google)

- Claude(Anthropic)

- Llama 3.1(Meta、HuggingFace 経由)

アカウント登録するだけで即利用でき、環境構築は不要。

まずは「どんなことができるか」を体験するのがスタートとして最適です。

例えば:

– 日常業務の文章作成や要約

– 資料作りの補助

– 簡単なコードの生成やデバッグ

– 学習や調べもののサポート

実際に質問や指示を出すことで、モデルが情報を理解し、返答する仕組みを肌感覚で掴めます。

小さな試みから始め、少しずつ使いこなし方を広げていきましょう。

2. ローカルLLMに挑戦してみる

次のステップは、自分のPCまたはサーバでLLMを動かしてみることです。

ローカルLLMとは?

クラウド経由ではなく、自分の端末(PCやサーバ)上で大規模言語モデルを動かすことを指します。

クラウド型は外部サーバに処理を依頼するのに対し、ローカルLLMはすべて自分の環境内で計算するため、

“社内や個人データを外部に出さずに処理可能”、”好きなようにカスタマイズできる”、”API料金を気にせず使える”

というメリットがあります。

2-1. ローカル実行のメリット

- 社内データを外部に出さずに利用できる

機密情報や顧客データをクラウドに送信せずに処理できるため、セキュリティやプライバシーの観点で安心です。法規制や社内ポリシーの制約がある環境でも活用しやすくなります。 - カスタマイズが自由

モデルの学習済みデータや出力形式を社内仕様に合わせて調整可能です。特定の業務用語や専門知識を優先的に扱わせることもできます。 - API料金を気にしなくていい

クラウドの従量課金や呼び出し回数の制限を気にせず、必要なだけモデルを利用できます。大規模なバッチ処理や長時間の解析にも向いています。

2-2. おすすめの実行環境

初めてローカルでLLMを動かす場合は、できるだけシンプルなツールから触るのがおすすめです。難しい設定なしで、すぐに「動いた!」を体験できます。

- Ollama

Mac/Windows/Linux どれでも使えて、使い方は “コマンド1行でモデルを動かす” だけ。とりあえずローカルでLLMを試したい人に最適です。

例:ollama run llama3 - LM Studio

完全GUIで、モデルのダウンロードや実行が全部ボタン操作。技術知識がなくても使いやすく、ローカルLLMの入口として一番とっつきやすいツールです。

3. 本格導入を検討するなら GPUサーバが必須

社内PoCやチャットBOTを安定稼働させたい場合、一般的なPCよりもGPUサーバが適します。

LLMの処理は圧倒的に「GPUのメモリ量(VRAM)」に依存するためです。

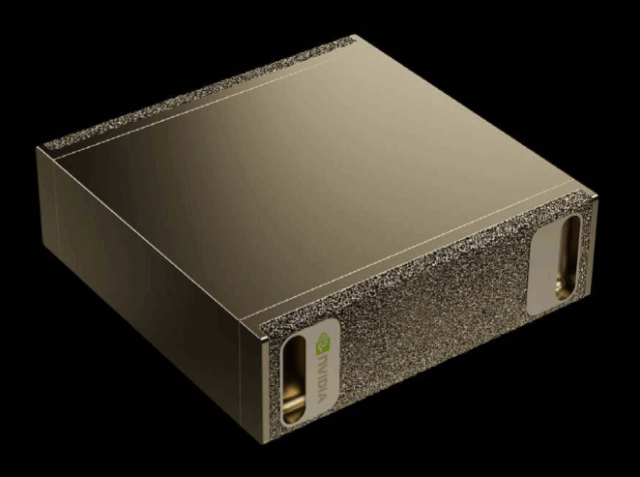

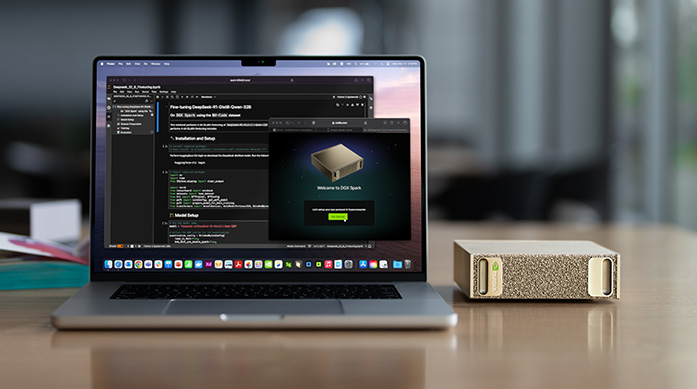

ここで注目すべきは、DGX Sparkの存在です。

小規模なPoCから本格運用まで、Sparkなら他のサーバでは体験できない大規模モデルの推論を高速・安定して実行できます。

「まず触ってみたい」から「業務に本格活用したい」まで、一台で幅広く対応できるのが最大の魅力です。

4. おすすめマシン紹介

■ ハイエンド:NVIDIA DGX Spark(最強のAIスターターキット)

本格的にAI研究・生成AIサービス運用を狙うなら、DGX Spark が現状トップクラスです。

- 強力な NVIDIA GB10 Grace Blackwell スーパーチップ を搭載

- NVIDIA DGX OS(Ubuntuベース)で安定稼働

- 最大 2,000 億個のパラメータモデルをサポート

- 2 つのシステムをリンクできるNVIDIA ConnectX(最大4,050 億個)

DGX Sparkは様々なメーカーよりOEM製品が登場してますので、お好みのメーカーよりお選びいただけます。

NVIDIA DGX Spark

NVMe 4TBモデル

899,800円(税込)

ASUS Ascent GX10

NVMe 1TBモデル

657,800円(税込)

Dell Pro Max with GB10

NVMe 4TBモデル

987,800円(税込)

MSI EdgeXpert

NVMe 4TBモデル

767,800円(税込)

MSI EdgeXpert (2台セット)

NVMe 4TBモデル・専用カスケードケーブル付属

1,537,800円(税込)

▼GDX Spark関連ブログはこちら

■ 中級者〜企業PoC向け:中古ワークステーション

- 高コスパ:RTX 6000 Ada / L40S 搭載ワークステーション

- VRAM 48GB のため 70Bモデルの量子化も扱える

- 電力効率が高い

- LLMの社内PoC、RAG検索、画像生成(Stable Diffusion系)に最適

- 低予算:RTX 5000 Ada 搭載モデル

- 個人開発者・小規模チーム向け

- VRAM 32GBでLlama 13B/70B量子化の実験に最適

- 消費電力控えめで導入しやすい

- サーバ用途向け:H200 搭載サーバ(中古)

- VRAM 141GBで長期利用にも強い

- RAG検索、社内チャットBOT、画像生成、微調整(LoRA)など幅広く対応

5. 最後に:まず触ってみることが一番大事です

LLLMの進化スピードは相変わらず速いですが、今は誰でもAIを活用できる絶好のタイミングです。

- 無料で高性能モデルを試せる

- 個人PCでもローカル実行が可能

- GPUサーバも手の届く価格帯へ

これまで専門家の領域だったことが、いまは驚くほど簡単に体験できるようになりました。

「AIを触ったことがない」「業務に本気で活かしたい」「まずは低コストで検証したい」

そんな方は、次の“3ステップ”で進めるのがおすすめです。

- クラウドでまず体験する(環境構築ゼロで一瞬)

- ローカルで試してみる(自分のデータで安全に実験)

- GPUサーバで本格運用へ(高速処理・大規模モデルも安定)

PoCや社内導入で「何を買えばいい?」と迷うなら、

DGX Spark か RTX Ada シリーズ搭載中古サーバが間違いのない選択肢です。